人工知能に命の優先度は判断できる? 自動運転技術の運用前に考えたい哲学的問い

公開日:2018/10/12

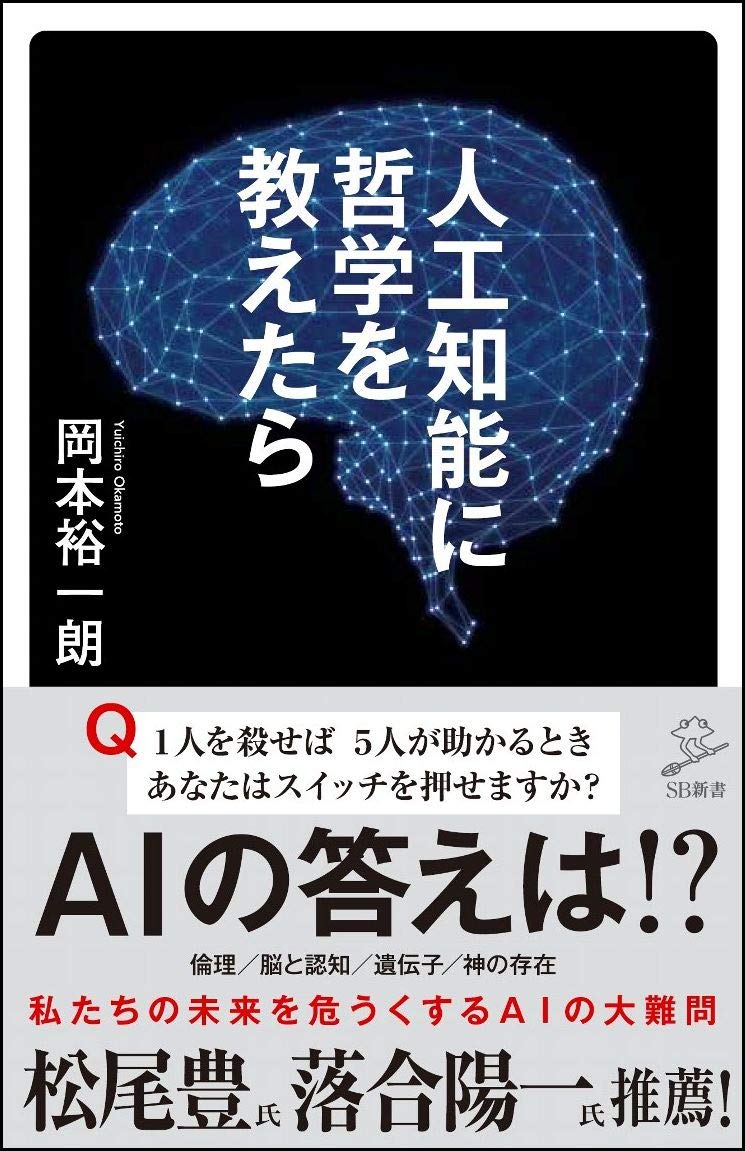

最初に断っておくが、本書『人工知能に哲学を教えたら』(岡本裕一朗/SBクリエイティブ)は、実際に人工知能に哲学を教えたわけではなく、「人工知能に哲学を教えてみたら、どうなるか考えてみよう!」という思考実験の本である。なぜなら、現実の世界では実験できないからである。

だが、人工知能を哲学的に検証してみる価値はある。それは、人工知能はこれまでのプログラムと違い、膨大な量のデータを学習させることにより、何をどう判断するかは人工知能にゆだねられているからだ。

思考実験はどのように行うのか。例をみてみよう。第1章は「AI vs 正義」で、「人工知能に倫理を教えられるか」がテーマである。まずはひとつ、有名な思考実験の問題について考えてみてほしい。

■5人の命か1人の命か…トロッコ問題

(A)ある人が、ブレーキのきかなくなったトロッコに遭遇した。電車の前方には、5人の作業員がいてこのままでは轢かれてしまう。近くに進路を変えるスイッチがあり、それを引くと電車は右に曲がる。ところが、右の線路の先には1人の作業員がおり、右に曲がると1人を轢いてしまう。どうすべきか?

(B)陸橋の上にいた人が、電車を見ていると、ブレーキがきかなくなっているのがわかった。その先には5人の作業員がいて、このままでは彼らを轢いてしまう。たまたま陸橋には太った人がいて、その人を線路に突き落とせば、電車が止まりそうである。5人の作業員を救うために、1人の太った人を突き落としてもよいか?

あなたはどう考えただろうか。何を優先させるか悩んだことと思う。実際アンケートをしてみると、人はAでは「1人を犠牲にする」と答えても、Bでは「1人を犠牲にしない」と答える傾向にある。実は、ここでのポイントは、「1人を救うか5人を救うか」という問い自体は変わらないにもかかわらず、AとBとで選ぶ答えが変わるところにある。

では、「トロッコ問題」のいったいどこが問題なのか。AもBも「5人の命と1人の命の比較」とみなせば、いずれも「5人の命」が優先されるはず。しかしBでは、結果がどうあれ、あえて人を「殺す」行為自体をすべきでないと考える。でもそれは、Aのあえてスイッチを引くのとどう違うのか。

すべての場合に妥当するような倫理はあるのか。これが「トロッコ問題」の基本的な問いである。「トロッコ問題」そのものに決定的な解決策がでていないうちに、それを「自動運転車」に応用したら、どうなってしまうのか。(自動運転は人工知能によって可能になる技術だ。)次は「トンネル問題」と呼ばれている状況を考えてみよう。

■子どもの命かあなたの命か…トンネル問題

あなたは自動運転車の乗員で、トンネルの入り口にさしかかろうとしている。そのとき、5人の子どもが突然、車の前に飛び出してきた。ブレーキは間にあわず、進路変更すれば子どもをよけられるがトンネルの壁に激突してしまう。子どもを轢けば子どもが死亡し、壁に激突すればあなたが死んでしまう。このとき、自動運転車はどう判断すべきか。

この状況で、問われるべきは次の2つの問いだ。

1.自動運転車はどう反応すればいいのか。直進するか、進路変更するか

2.クルマがどう反応するかをいったい誰が決定すべきか

以前、ある自動車メーカーのエンジニアが、あくまでも非公式的な形で方針を示したことがある。それによると、メーカーとしては「乗員ファースト!」を宣言するとのこと。乗員第一に設計されていない車を誰が買うだろうかと考えれば当然だが、しかし、もし飛び出してきた子どもが10人だったら、乗員ファーストのままで社会的な批判を避けられるだろうか。

このように、本書では思考実験によって、哲学的な観点から人工知能を考える。「人工知能はアートを理解できるか?」「人工知能にとって幸福とは何か?」「人工知能は人間の仕事を奪うのか?」など7つのテーマが設けられている。

人工知能が担う領域はこれからますます拡大し日常生活に溶け込んでくるのは間違いない。それによって社会の根底にある概念や倫理観は大きな影響を受け、多少なりとも変化していくだろう。人工知能によって生じる哲学的な問題は、意外と身近な問題なのかもしれない。

文=高橋輝実